ChatGPT-4o是什么?与GTP4的区别是什么?-ChatGPT-4o账号购买专区!

5月中旬OpenAIQ在他们备受瞩目的“春季新品发布盛典”中,隆重推出了他们的最新旗舰级生成模型——GPT-4o,以及一款全新的桌面应用程序。在这次活动中,他们向世界展示了模型的一系列创新功能。技术的进步彻底改变了产品的设计,OpenAIQ的GPT-4o全能模型,凭借其实时的语音和视觉处理能力,再次引领了人工智能技术的新潮流。

什么是ChatGPT-4o?

ChatGPT-4、ChatGPT-4o、ChatGPT-4Turbo对比有什么区别?

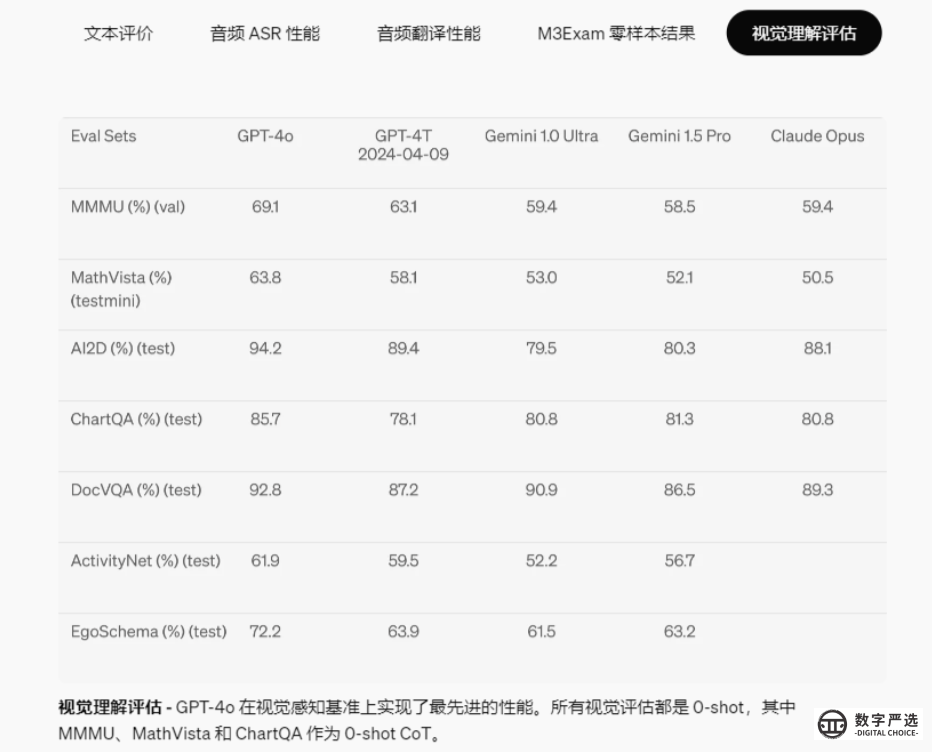

当我们深入比较GPT-4o与GPT-4的性能时,有几个关键点值得关注。首先,这两个AI模型在响应速度和处理能力上有明显的区别。其次,不同的应用场景或领域可能会影响这两个模型的性能表现。如果你和我一样,是一个热衷于探索和比较最新科技的高中生,那么你很可能已经注意到了GPT-4o在反应速度上的显著优势。据公开资料显示,GPT-4o的处理速度是GPT-4 Turbo的两倍。这表明GPT-4o能够在相同时间内完成更多的任务,或者对用户请求做出更迅速的响应。

在执行简单任务时,GPT-4o和GPT-4的表现相当接近,但由于GPT-4o的响应速度更快,它在实时信息获取方面可能是一个更佳的选择。

对于解决复杂问题,尽管GPT-4可能在某些方面表现得略胜一筹,但GPT-4o的响应速度同样令人印象深刻。

在性价比方面,GPT-4o可能拥有一些优势。它不仅速度更快,而且成本降低了50%,这使得它在价格上更具吸引力。

ChatGPT-4o语音交互功能

在GPT-4o问世之前,与ChatGPT进行语音对话的平均延迟时间分别为2.8秒(GPT-3.5版本)和5.4秒(GPT-4版本)。为了达到这样的效果,语音模式实际上是由三个不同的模型串联而成的系统:首先是将音频转换为文本的转录模型,然后是GPT-3.5或GPT-4模型,它们接收文本并生成文本输出,最后是一个将文本转换回音频的模型。这种设计意味着,作为主要智能核心的GPT-4模型错过了许多重要的信息——它无法直接感知语调变化、多声源环境或背景噪音,也无法生成带有笑声、歌唱或情感表达的音频输出。

GPT-4o的推出标志着一个全新的里程碑,因为它是我们首次端到端训练的模型,能够同时处理文本、视觉和音频数据。这意味着所有的输入和输出都由同一个神经网络统一处理。由于GPT-4o是首个集这些功能于一身的模型,我们目前还只是初步探索了它的潜力和可能的局限。

普通ChatGPT-4o与付费之间的差别

- 标准版的GPT-4o不具备绘图或文件传输功能(尽管某些版本可能支持文件传输)。付费用户则可以享受这些功能。

- 标准版GPT-4o的用户每3小时只能发送10条消息。

- ChatGPT Plus用户在GPT-4o上每3小时可以发送最多80条消息,在GPT-4上仍然是40条。当GPT-4的消息额度用完后,用户可以切换到GPT-4o,但如果GPT-4o的80条消息额度也用完,则无法再使用GPT-4。

- Team用户可以享受每3小时100条消息的限制,并且这个额度与GPT-4共享。

- 标准版GPT-4o的消息长度限制为8000字符,而付费版则提升至32000字符。

- 在能力测试中,GPT-4o的表现不及GPT-4 Turbo系列。

ChatGPT-4o账号购买

-

ChatPDF官方网站Plus会员代充值促销产品¥209 – ¥1400

-

ChatGPT Plus会员账号购买| 全网最低168¥/月! 30 天质保 | 已支持o1| 独享账号可改密 | 全网最佳售后促销产品¥5 – ¥1150

数字严选,信赖之选

好评如潮: